|

Édition du: 27/01/2025 |

|

INDEX |

LOGIQUE et IA |

|||

![]()

|

INTELLIGENCE ARTIFICIELLE HISTORIQUE |

|||

|

|

Sommaire de cette page >>> Historique >>> Évolution

technologique |

Image

totalement créée

par Nvidia |

Débutants Glossaire |

Anglais: Artificial Intelligence – A.I.

|

|

||

|

1308 |

|

|

|

1666 |

|

|

|

1726 |

|

|

|

1763 |

|

|

|

1854 |

|

|

|

1898 |

|

|

|

1900 |

|

|

|

1914 |

|

|

|

1920 |

|

|

|

1925 |

|

|

|

1929 |

|

|

|

1931 |

|

|

|

1936 |

|

|

|

1940 |

|

|

|

1943 |

|

|

|

1944 |

de

Turing, et de

von

Neumann. |

|

|

1945 |

|

|

|

1949 |

|

|

|

1949 1950 |

|

|

|

1950 |

|

|

1952 |

|

|

1955 |

|

|

1955 |

|

|

1955 |

|

|

1957 |

|

|

1958 |

|

|

1959 |

|

|

1959 |

|

|

1961 |

|

|

1961 |

|

|

1961 |

|

|

1964 |

|

|

1965 |

|

|

1966 |

|

|

1967 |

|

|

1968 |

|

|

1969 |

|

|

1969 |

|

|

1970 |

|

|

1971 |

|

|

1972 |

|

|

1976 |

|

|

1986 |

|

|

1986 |

|

|

1989 |

|

|

1997 |

|

|

1998 |

|

|

|

|

|

|

Applications

|

|

2000 |

|

|

2009 |

|

|

2011 |

|

|

2016 |

|

Voir Histoire des mathématiques et des sciences /

Histoire de la neuronique /

Événement des années

1900 / Inventions des années 1900

|

|

||

|

1950 –

Alan Turing

utilise le terme intelligence artificielle dans l'un de ses articles. 1950 –

Années qui voient les premières réflexions sur l'IA sans émerger faute de puissance de

calcul et de mémoire 1956 –

Conférence au Darmouth College, naissance de l'IA, réunissant les acteurs

importants de l'IA, parmi lesquels: Marvin Minsky, John McCarthy, Claude Shannon et

Nathan Rochester. 1959 –

Arthur Samuel (IBM) présente un jeu de dames qui s'améliore à chaque partie

jouée. 1986 –

Rina Dechter – Premiers concepts de

l'apprentissage profond. 1989 –

Yann Le Cun – Première application: un réseau de

neurones artificiels profond reconnait les codes postaux écrits à la main

sur des lettres. 1990's –

Début de l'IA avec apprentissage. 1997 – Deep

Blue, le superordinateur d'IBM, bat le champion des échecs. |

Test de Turing: Il consiste à engager une conversation masquée entre

un humain, une machine, et un autre humain. Si le premier humain n’est pas en

mesure de désigner l’interlocuteur qui est une machine, alors cette dernière

passe le test de Turing. IA forte: dotée de conscience et donc d’une sensibilité particulière. Domaine

encore de la science-fiction. IA faible: programme qui n’est pas doté de sens et se

concentre uniquement sur la tâche pour laquelle il a été programmé. Celle qui

est en cours de développement explosif. Algorithme: programme dédié à une tâche et qui n'évolue pas. Réseaux de neurones artificiels: réseaux

informatiques à plusieurs couches, constitués de nœuds programmables

automatiquement à la suite d'un apprentissage. |

|

|

|

||

|

2009 –

Année considérée comme le point de départ de l'apprentissage profond. 2011 – Watson:

programme IBM conçu dans le but de répondre à des questions formulées en

langage naturel. Champion du jeu télévisé américain Jeopardy. 2012 –

Andrew Ng (né en 1976) fonde Google Brain et crée une architecture comportant

de nombreuses couches. Sa machine apprend à reconnaitre les chats sur des

images. 2012 – Progrès des

composants informatiques qui autorisent l'implémentation de l'IA. Les GPU

permettent de réaliser des traitements parallèles 2014 – AlphaGo

de DeepMind (Google) bat le champion du jeu de GO. 2015 –

Capacité à mémoriser des quantités astronomiques de données. |

Machine à apprentissage profond (machine

learning and deep learning): exploitation de nombreuses données pour parfaire

automatiquement la performance du programme, du réseau de neurones. Plus

profond avec plus de couches. GPU, Graphic Processor Unit: processor

graphique, microprocesseur dédié qui décuple (centuple) la puissance

traitement en apprentissage profond. GAN: Generative Adversarial Networks. Réseau de neurones

qui simule une information (une image, par exemple) et la soumet à un autre

réseau de neurones pour tester sa capacité à reconnaitre le vrai du faux

parmi de vraies informations (images) et, ainsi améliorer sa performance. Le

premier réseau est le générateur et le second le discriminateur. |

|

|

2022 –

Révolution de l'IA générative avec ChatGPT >>> 2024 – IA

à modèles de raisonnement >>> 2025 – Quatre modèles d'IA

génératives >>> |

||

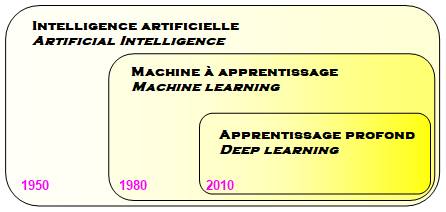

D'après Intelligence

artificielle, machine learning, deep learning : quelles différences ? –

Valentin

Blanchot – Siècle Digital – Janvier 2019

![]()

|

Suite |

||

|

Voir |

|

|

|

Sites |

|

|

|

Cette

page |

||

![]()